12.00.12 Технологія Deepfake, що дозволяє редагувати відеоролики, несе загрозу національній безпеці | |

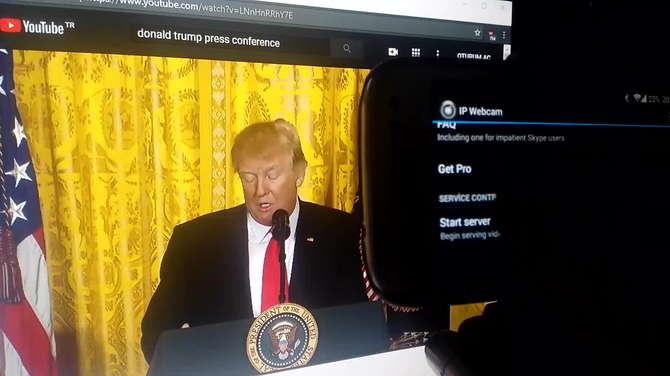

Технологія редагування відеороликів Deepfake, що дозволяє мінімальними зусиллями підміняти одну особу іншою за допомогою нейронних мереж, викликає все більше занепокоєння у американських політиків. Ініціативна група, що складається з трьох законодавців - двох демократів і одного республіканця, надіслала лист директорові Національної розвідки США Дену Коутсу з проханням оцінити загрозу, яку представляє нова форма фальсифікації, а також розробити відповідні контрзаходи і дати рекомендації Конгресу.

У листі йдеться, що «дуже реалістичні цифрові підробки», які демонструють «переконливі зображення людей, що роблять або говорять те, що вони ніколи не робили», можуть бути використані для шантажу і дезінформації. «Оскільки ця технологія продовжує розвиватися і стає все більш доступною, вона може становити загрозу для публічного дискурсу та національної безпеки Сполучених Штатів», - зазначають автори листа з Палати представників Адам Шифф, Стефані Мерфі і Карлос Курбело. У заяві для преси Курбело уточнив, що «такого роду підробки потенційно можуть порушити цілісність нашого суспільства і викликати небезпечні міжнародні та внутрішні наслідки». На думку політика, в майбутньому технологією обов'язково скористаються «агенти впливу з-за кордону» - в тому числі, російські боти, - для того, щоб вплинути на хід американських виборів. «Як і в випадку з будь-якою загрозою, наша розвідка повинна бути готова боротися з ними», - заявив Курбело. Перші «глибокі фейки» з'явилися в 2016 році: користувачі Reddit почали використовувати передові розробки в області ШІ, щоб вставляти обличчя знаменитостей в відео для дорослих. Термін «Deepfake» поєднує в собі два інших - «глибоке навчання» і «підробки». Такі інструменти фактично перетворюють людей в віртуальних маріонеток, синхронізуючи їх роти з чужою мовою або просто змушуючи їх танцювати. Наостанок зазначимо, що політики не вперше звертають увагу на цю технологію.

Джерела: hightech.fm, The Intercept | |

|

| |

| Всього коментарів: 0 | |